Bildschirmauflösung - Display resolution

Die Anzeigeauflösung oder Anzeigemodi eines digitalen Fernsehers , Computermonitors oder Anzeigegeräts ist die Anzahl der unterschiedlichen Pixel in jeder Dimension, die angezeigt werden können. Dies kann ein mehrdeutiger Begriff sein, insbesondere da die angezeigte Auflösung bei Kathodenstrahlröhren- (CRT-)Displays, Flachbildschirmen (einschließlich Flüssigkristalldisplays ) und Projektionsdisplays unter Verwendung fester Bildelementarrays (Pixel) durch verschiedene Faktoren gesteuert wird .

Es wird normalerweise als Breite × Höhe angegeben , mit den Einheiten in Pixeln: 1024 × 768 bedeutet beispielsweise, dass die Breite 1024 Pixel und die Höhe 768 Pixel beträgt. Dieses Beispiel würde normalerweise als "zehn vierundzwanzig mal sieben achtundsechzig" oder "zehn vierundzwanzig mal sieben sechs acht" gesprochen.

Eine Verwendung des Begriffs Bildschirmauflösung bezieht sich auf Festpixel-Array-Displays wie Plasma-Display-Panels (PDP), Flüssigkristall-Displays (LCD), Digital Light Processing (DLP)-Projektoren, OLED- Displays und ähnliche Technologien und ist einfach die physikalische Anzahl von Spalten und Zeilen von Pixeln, die die Anzeige bilden (zB 1920 × 1080 ). Eine Folge einer Anzeige mit festem Raster ist, dass für Multiformat-Videoeingänge alle Anzeigen eine "Skalierungsmaschine" (einen digitalen Videoprozessor mit einem Speicherarray) benötigen, um das eingehende Bildformat an die Anzeige anzupassen.

Für Gerätedisplays wie Telefone, Tablets, Monitore und Fernsehgeräte ist die Verwendung des Begriffs Displayauflösung wie oben definiert eine falsche Bezeichnung, obwohl sie üblich ist. Der Begriff Bildschirmauflösung wird normalerweise verwendet, um Pixeldimensionen zu bezeichnen , die maximale Anzahl von Pixeln in jeder Dimension (z. B. 1920 × 1080 ), die nichts über die Pixeldichte des Displays aussagt, auf dem das Bild tatsächlich erzeugt wird: zur Pixeldichte , die Anzahl der Pixel pro Einheitsabstand oder Fläche, nicht die Gesamtanzahl der Pixel. Bei der digitalen Messung würde die Bildschirmauflösung in Pixel pro Zoll (PPI) angegeben. Bei einer analogen Messung, wenn der Bildschirm 10 Zoll hoch ist, wird die horizontale Auflösung über ein 10 Zoll breites Quadrat gemessen. Für Fernsehnormen wird dies typischerweise als "Zeilen horizontale Auflösung pro Bildhöhe" angegeben; zum Beispiel können analoge NTSC- Fernseher typischerweise ungefähr 340 Zeilen einer horizontalen Auflösung "pro Bildhöhe" von Over-the-Air-Quellen anzeigen, was ungefähr 440 Gesamtzeilen der tatsächlichen Bildinformationen vom linken Rand zum rechten Rand entspricht.

Hintergrund

Einige Kommentatoren auch Bildschirmauflösung verwenden , um eine Reihe von Eingabeformate , um anzuzeigen , dass die Eingangselektronik Display akzeptiert und oft auch Formate größer als die natürliche Gittergröße des Bildschirms , auch wenn sie nach unten skaliert werden müssen , um die Parameter des Bildschirms übereinstimmen (zB eine Annahme 1920 × 1080- Eingang auf einem Display mit einem nativen 1366 × 768- Pixel-Array). Im Fall von Fernseheingängen nehmen viele Hersteller die Eingabe und verkleinern sie, um die Anzeige um bis zu 5% zu " überscannen ", sodass die Eingabeauflösung nicht unbedingt die Anzeigeauflösung ist.

Die Wahrnehmung der Bildschirmauflösung durch das Auge kann durch eine Reihe von Faktoren beeinflusst werden – siehe Bildauflösung und optische Auflösung . Ein Faktor ist die rechteckige Form des Bildschirms, die als Verhältnis der physikalischen Bildbreite zur physikalischen Bildhöhe ausgedrückt wird. Dies wird als Seitenverhältnis bezeichnet . Das physikalische Seitenverhältnis eines Bildschirms und das Seitenverhältnis der einzelnen Pixel müssen nicht unbedingt gleich sein. Ein Array von 1280 × 720 auf einem 16:9- Display hat quadratische Pixel, aber ein Array von 1024 × 768 auf einem 16:9-Display hat längliche Pixel.

Ein Beispiel für eine Pixelform, die die "Auflösung" oder die wahrgenommene Schärfe beeinflusst: Die Anzeige von mehr Informationen in einem kleineren Bereich mit einer höheren Auflösung macht das Bild viel klarer oder "schärfer". Die neuesten Bildschirmtechnologien sind jedoch auf eine bestimmte Auflösung festgelegt; die Auflösung machen niedriger auf diese Art von Bildschirmen wird die Schärfe stark verringern, als ein Interpolationsvorgang der das nicht-native Auflösung Eingang auf „Fix“ in der Anzeige verwendet wird , native Auflösung ausgegeben.

Während einige CRT-basierte Displays eine digitale Videoverarbeitung verwenden können , die eine Bildskalierung unter Verwendung von Speicherarrays beinhaltet, wird die "Displayauflösung" bei CRT-Displays letztendlich von verschiedenen Parametern wie Spotgröße und Fokus, astigmatischen Effekten in den Displayecken, der Farbe beeinflusst Phosphor-Pitch- Schattenmaske (wie Trinitron ) in Farbdisplays und die Videobandbreite.

Aspekte

Overscan und Underscan

Die meisten Hersteller von Fernsehbildschirmen "überscannen" die Bilder auf ihren Bildschirmen (CRTs und PDPs, LCDs usw.), sodass das effektive Bildschirmbild beispielsweise von 720 × 576 (480) auf 680 × 550 (450) reduziert werden kann . Die Größe des unsichtbaren Bereichs hängt etwas vom Anzeigegerät ab. Einige HD-Fernseher tun dies in ähnlichem Umfang auch.

Computerbildschirme einschließlich Projektoren überscannen im Allgemeinen nicht, obwohl viele Modelle (insbesondere CRT-Bildschirme) dies zulassen. CRT-Displays werden in Standardkonfigurationen tendenziell unterabgetastet, um die zunehmenden Verzerrungen an den Ecken auszugleichen.

Interlaced versus Progressive Scan

Interlaced-Video (auch als Interlaced-Scan bezeichnet ) ist eine Technik zum Verdoppeln der wahrgenommenen Bildrate einer Videoanzeige, ohne zusätzliche Bandbreite zu verbrauchen . Das Zeilensprungsignal enthält zwei nacheinander aufgenommene Halbbilder eines Videorahmens. Dies verbessert die Bewegungswahrnehmung für den Betrachter und reduziert das Flimmern, indem das Phi-Phänomen ausgenutzt wird .

Die Europäische Rundfunkunion hat sich gegen Interlaced-Video in Produktion und Rundfunk ausgesprochen. Das Hauptargument ist, dass, egal wie komplex der Deinterlacing-Algorithmus auch sein mag, die Artefakte im Interlaced-Signal nicht vollständig eliminiert werden können, da einige Informationen zwischen den Frames verloren gehen. Trotz Gegenargumente unterstützen Fernsehnormenorganisationen weiterhin Interlacing. Es ist immer noch in digitalen Videoübertragungsformaten wie DV , DVB und ATSC enthalten . Neue Videokomprimierungsstandards wie High Efficiency Video Coding sind für Progressive Scan- Video optimiert , unterstützen jedoch manchmal Interlaced-Video.

Progressives Abtasten (alternativ als Abtasten ohne Zeilensprung bezeichnet ) ist ein Format zum Anzeigen, Speichern oder Übertragen von bewegten Bildern, bei dem alle Zeilen jedes Rahmens nacheinander gezeichnet werden. Dies steht im Gegensatz zu Interlaced-Video, das in herkömmlichen analogen Fernsehsystemen verwendet wird, bei dem nur die ungeraden Zeilen und dann die geraden Zeilen jedes Frames (jedes Bild als Videofeld bezeichnet ) abwechselnd gezeichnet werden, so dass nur die Hälfte der tatsächlichen Bildframes verwendet werden Videos zu produzieren.

Fernseher

Aktuelle Normen

Fernseher haben folgende Auflösungen:

- Fernsehen in Standardauflösung ( SDTV ):

- 480i ( NTSC-kompatibeler digitaler Standard Verwendung von zwei verschachtelten Feldern von 243 Zeilen a )

- 576i ( PAL-kompatibler digitaler Standard mit zwei Halbbildern mit jeweils 288 Zeilen)

- Fernsehen mit verbesserter Auflösung ( EDTV ):

- 480p ( 720 × 480 Progressive Scan )

- 576p ( 720 × 576 Progressive Scan)

- Hochauflösendes Fernsehen ( HDTV ):

- Ultra-High-Definition-Fernsehen ( UHDTV ):

Computermonitore

Computermonitore haben traditionell höhere Auflösungen als die meisten Fernseher.

Entwicklung von Standards

Viele PCs, die in den späten 1970er und 1980er Jahren eingeführt wurden, wurden entwickelt, um Fernsehempfänger als Anzeigegeräte zu verwenden, wodurch die Auflösungen von den verwendeten Fernsehstandards, einschließlich PAL und NTSC, abhängig sind . Die Bildgrößen waren normalerweise begrenzt, um die Sichtbarkeit aller Pixel in den wichtigsten Fernsehnormen und der breiten Palette von Fernsehgeräten mit unterschiedlichen Overscan-Werten zu gewährleisten. Der eigentliche zeichnerische Bildbereich war daher etwas kleiner als der gesamte Bildschirm und wurde in der Regel von einem statisch farbigen Rahmen umgeben (siehe Bild rechts). Außerdem wurde die Zeilensprungabtastung normalerweise weggelassen, um dem Bild mehr Stabilität zu verleihen, wodurch die laufende vertikale Auflösung effektiv halbiert wurde. 160 × 200 , 320 × 200 und 640 × 200 auf NTSC waren zu dieser Zeit relativ gebräuchliche Auflösungen (224, 240 oder 256 Scanzeilen waren ebenfalls üblich). In der IBM-PC-Welt wurden diese Auflösungen von 16-Farben- EGA -Grafikkarten verwendet.

Einer der Nachteile bei der Verwendung eines klassischen Fernsehers besteht darin, dass die Bildschirmauflösung des Computers höher ist, als der Fernseher dekodieren könnte. Die Chroma-Auflösung für NTSC/PAL-Fernseher ist bandbreitenbegrenzt auf maximal 1,5 MHz oder etwa 160 Pixel breit, was bei 320- oder 640-breit-Signalen zu einer Unschärfe der Farbe führte und die Lesbarkeit von Text erschwerte (siehe Beispielbild unten). ). Viele Benutzer haben auf höherwertige Fernseher mit S-Video- oder RGBI- Eingängen aufgerüstet, die dazu beigetragen haben, Chroma-Unschärfe zu beseitigen und besser lesbare Displays zu erzeugen. Die früheste und kostengünstigste Lösung für das Chroma-Problem wurde im Atari 2600 Video Computer System und dem Apple II+ angeboten , die beide die Möglichkeit boten, die Farbe zu deaktivieren und ein älteres Schwarz-Weiß-Signal anzuzeigen. Auf dem Commodore 64 spiegelte GEOS die Mac OS-Methode wider, Schwarzweiß zu verwenden, um die Lesbarkeit zu verbessern.

Die Auflösung von 640 × 400i ( 720 × 480i mit deaktivierten Rändern) wurde zuerst von Heimcomputern wie dem Commodore Amiga und später Atari Falcon eingeführt. Diese Computer verwendeten Interlace, um die maximale vertikale Auflösung zu erhöhen. Diese Modi waren nur für Grafiken oder Spiele geeignet, da das flackernde Interlace das Lesen von Text in Textverarbeitungs-, Datenbank- oder Tabellenkalkulationsprogrammen erschwerte. (Moderne Spielekonsolen lösen dieses Problem, indem sie das 480i-Video auf eine niedrigere Auflösung vorfiltern. Final Fantasy XII leidet beispielsweise unter Flimmern, wenn der Filter ausgeschaltet wird, stabilisiert sich jedoch, sobald die Filterung wiederhergestellt ist. Den Computern der 1980er Jahre fehlte es an ausreichender Leistung um eine ähnliche Filtersoftware auszuführen.)

Der Vorteil eines 720 × 480i Overscanned-Computers war eine einfache Schnittstelle zur Interlaced-TV-Produktion, die zur Entwicklung von Newteks Video Toaster führte . Dieses Gerät ermöglichte den Einsatz von Amigas für die CGI-Erstellung in verschiedenen Nachrichtenabteilungen (Beispiel: Wetterüberlagerungen), Drama-Programmen wie NBCs seaQuest , The WBs Babylon 5 .

In der PC-Welt nutzten die IBM PS/2 VGA (multi-color) Onboard-Grafikchips eine Non-Interlaced (progressive) Farbauflösung von 640 × 480 × 16, die besser lesbar und damit für die Büroarbeit nützlicher war. Es war die Standardauflösung von 1990 bis etwa 1996. [ Zitat erforderlich ] Die Standardauflösung war 800 × 600 bis etwa 2000. Microsoft Windows XP , das 2001 veröffentlicht wurde, wurde für eine Mindestauflösung von 800 × 600 entwickelt , obwohl es möglich ist, auszuwählen das Original 640 × 480 im Fenster Erweiterte Einstellungen.

Programme, die entwickelt wurden, um ältere Hardware wie Atari, Sega oder Nintendo-Spielkonsolen (Emulatoren) zu imitieren, wenn sie an Multiscan-CRTs angeschlossen sind, verwenden routinemäßig viel niedrigere Auflösungen, wie 160 × 200 oder 320 × 400 für eine größere Authentizität, obwohl andere Emulatoren davon profitiert haben der Pixelerkennung bei Kreis, Quadrat, Dreieck und anderen geometrischen Merkmalen bei einer geringeren Auflösung für ein skalierteres Vektor-Rendering. Einige Emulatoren können bei höheren Auflösungen sogar das Blendengitter und die Schattenmasken von CRT-Monitoren nachahmen.

Im Jahr 2002 war 1024 × 768 eXtended Graphics Array die gängigste Bildschirmauflösung. Viele Websites und Multimedia-Produkte wurden vom bisherigen Format 800 × 600 auf die für 1024 × 768 optimierten Layouts umgestaltet .

Die Verfügbarkeit preiswerter LCD-Monitore machte die Auflösung des 5∶4-Seitenverhältnisses von 1280 × 1024 im ersten Jahrzehnt des 21. Jahrhunderts für den Desktop-Einsatz beliebter. Viele Computerbenutzer, darunter CAD- Benutzer, Grafiker und Videospielspieler, ließen ihre Computer mit einer Auflösung von 1600 × 1200 ( UXGA ) oder höher wie 2048 × 1536 QXGA laufen, wenn sie die erforderliche Ausrüstung hatten. Andere verfügbare Auflösungen umfassten Oversize-Aspekte wie 1400 × 1050 SXGA+ und Wide-Aspekte wie 1280 × 800 WXGA , 1440 × 900 WXGA+ , 1680 × 1050 WSXGA+ und 1920 × 1200 WUXGA ; Monitore, die nach dem 720p- und 1080p-Standard gebaut wurden, waren aufgrund der perfekten Bildschirmkompatibilität mit Film- und Videospielversionen auch bei Heimmedien- und Videospielspielern nicht ungewöhnlich. Eine neue Mehr-als-HD-Auflösung von 2560 × 1600 WQXGA wurde 2007 in 30-Zoll-LCD-Monitoren veröffentlicht.

Im Jahr 2010 wurden 27-Zoll-LCD-Monitore mit der Auflösung 2560 × 1440 von mehreren Herstellern veröffentlicht, und im Jahr 2012 führte Apple ein 2880 × 1800- Display auf dem MacBook Pro ein . Panels für professionelle Umgebungen, wie medizinische Anwendungen und Flugsicherung, unterstützen Auflösungen bis zu 4096 × 2160 (oder, relevanter für Kontrollräume, 1∶1 2048 × 2048 Pixel).

In diesem Bild eines Commodore 64- Startbildschirms wäre der Overscan- Bereich (der hellere Rand) auf einem normalen Fernseher kaum sichtbar gewesen.

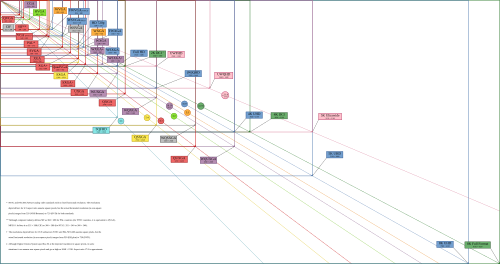

Gängige Bildschirmauflösungen

Weitere Informationen: Liste der gängigen Beschlüsse

Die folgende Tabelle listet den Nutzungsanteil der Bildschirmauflösungen aus zwei Quellen mit Stand Juni 2020 auf. Die Zahlen sind nicht repräsentativ für Computerbenutzer im Allgemeinen.

| Standard | Seitenverhältnis | Breite ( px ) | Höhe (px) | Megapixel | Dampf (%) | Statistikzähler (%) |

|---|---|---|---|---|---|---|

| nHD | 16:9 | 640 | 360 | 0,230 | N / A | 0,47 |

| SVGA | 4:3 | 800 | 600 | 0,480 | N / A | 0,76 |

| XGA | 4:3 | 1024 | 768 | 0,786 | 0,38 | 2,78 |

| WXGA | 16:9 | 1280 | 720 | 0,922 | 0,36 | 4.82 |

| WXGA | 16:10 | 1280 | 800 | 1.024 | 0,61 | 3.08 |

| SXGA | 5:4 | 1280 | 1024 | 1.311 | 1,24 | 2.47 |

| HD | ≈16:9 | 1360 | 768 | 1.044 | 1,55 | 1.38 |

| HD | ≈16:9 | 1366 | 768 | 1.049 | 10.22 | 23.26 |

| WXGA+ | 16:10 | 1440 | 900 | 1.296 | 3.12 | 6.98 |

| N / A | 16:9 | 1536 | 864 | 1.327 | N / A | 8.53 |

| HD+ | 16:9 | 1600 | 900 | 1.440 | 2.59 | 4.14 |

| WSXGA+ | 16:10 | 1680 | 1050 | 1.764 | 1,97 | 2.23 |

| FHD | 16:9 | 1920 | 1080 | 2.074 | 64,81 | 20.41 |

| WUXGA | 16:10 | 1920 | 1200 | 2.304 | 0,81 | 0,93 |

| QWXGA | 16:9 | 2048 | 1152 | 2.359 | N / A | 0,51 |

| N / A | 21:9 | 2560 | 1080 | 2.765 | 1,13 | N / A |

| QHD | 16:9 | 2560 | 1440 | 3,686 | 6.23 | 2.15 |

| N / A | 21:9 | 3440 | 1440 | 4.954 | 0,87 | N / A |

| 4K UHD | 16:9 | 3840 | 2160 | 8.294 | 2.12 | N / A |

| Sonstiges | 2,00 | 15.09 |

In den letzten Jahren hat sich das Seitenverhältnis 16:9 bei Notebook-Displays durchgesetzt. 1366 × 768 ( HD ) hat sich für die meisten Low-Cost-Notebooks durchgesetzt, während 1920 × 1080 ( FHD ) und höhere Auflösungen für Premium-Notebooks verfügbar sind.

Wenn die Bildschirmauflösung eines Computers höher eingestellt ist als die physische Bildschirmauflösung ( native Auflösung ), machen einige Videotreiber den virtuellen Bildschirm über den physischen Bildschirm scrollbar, wodurch ein zweidimensionaler virtueller Desktop mit seinem Ansichtsfenster realisiert wird. Die meisten LCD-Hersteller beachten die native Auflösung des Panels, da das Arbeiten mit einer nicht nativen Auflösung auf LCDs zu einem schlechteren Bild führt, da Pixel fallen gelassen werden, um das Bild anzupassen (bei Verwendung von DVI) oder das analoge Signal unzureichend abgetastet wird (bei Verwendung eines VGA-Anschlusses). Nur wenige CRT-Hersteller werden die echte native Auflösung angeben, da CRTs von Natur aus analog sind und ihre Anzeige von 320 × 200 (Emulation älterer Computer oder Spielekonsolen) bis zu so hoch variieren können, wie es die interne Platine oder das Bild zulässt wird zu detailliert, als dass die Vakuumröhre sie wiedergeben könnte ( dh analoge Unschärfe). Somit bieten Kathodenstrahlröhren eine Auflösungsvariabilität, die LCDs mit fester Auflösung nicht bieten können.

Filmindustrie

Was die digitale Kinematographie betrifft, hängen die Videoauflösungsstandards zunächst vom Seitenverhältnis der Einzelbilder im Filmmaterial (das normalerweise für die digitale Zwischenpostproduktion gescannt wird ) und dann von der tatsächlichen Punktzahl ab. Obwohl es keinen eindeutigen Satz standardisierter Größen gibt, ist es in der Filmindustrie üblich, sich auf die " n K" -Bildqualität zu beziehen , wobei n eine (kleine, normalerweise gerade) ganze Zahl ist, die sich in eine Menge von tatsächlichen Auflösungen, abhängig vom Filmformat . Als Referenz zu berücksichtigen , dass für ein 4: 3 (etwa 1,33: 1) Seitenverhältnis , das ein Filmrahmen (ganz gleich , was sein Format ist) zu erwarten ist horizontal zu passen , n ist der Multiplikator von 1024 , so daß die horizontalen Auflösung genau 1024•n Punkte. Die 2K-Referenzauflösung beträgt beispielsweise 2048 × 1536 Pixel, während die 4K-Referenzauflösung 4096 × 3072 Pixel beträgt . Dennoch kann sich 2K auch auf Auflösungen wie 2048 × 1556 (volle Blende), 2048 × 1152 ( HDTV , 16:9 Seitenverhältnis) oder 2048 × 872 Pixel ( Cinemascope , 2,35:1 Seitenverhältnis) beziehen . Es ist auch erwähnenswert, dass die Bildauflösung zwar beispielsweise 3:2 ( 720 × 480 NTSC) betragen kann, dies jedoch nicht das ist, was Sie auf dem Bildschirm sehen (dh 4:3 oder 16:9, je nach gewünschtem Seitenverhältnis). Verhältnis des Originalmaterials).

Siehe auch

- Auflösung der Grafikanzeige

- Computeranzeigestandard

- Anzeige-Seitenverhältnis

- Bildschirmgröße

- Ultrawide-Formate

- Pixeldichte von Computerdisplays – PPI (z. B. hat ein 20-Zoll-Bildschirm mit 1680 × 1050 einen PPI von 99,06)

- Auflösungsunabhängigkeit

- Videoskalierer

- Breitbild