Modellauswahl - Model selection

Die Modellauswahl ist die Aufgabe, ein statistisches Modell aus einem Satz von Kandidatenmodellen bei gegebenen Daten auszuwählen . Im einfachsten Fall wird ein bereits vorhandener Datensatz berücksichtigt. Die Aufgabe kann aber auch darin bestehen, Experimente so zu gestalten, dass die erhobenen Daten für das Problem der Modellauswahl gut geeignet sind. Bei Kandidatenmodellen mit ähnlicher Vorhersage- oder Erklärungskraft ist das einfachste Modell höchstwahrscheinlich die beste Wahl ( Occams Rasiermesser ).

Konishi & Kitagawa (2008 , S. 75) stellen fest: „Die meisten Probleme bei der statistischen Inferenz können als Probleme im Zusammenhang mit der statistischen Modellierung angesehen werden“. In ähnlicher Weise hat Cox (2006 , S. 197) gesagt: "Wie [die] Übersetzung von einem fachlichen Problem in ein statistisches Modell erfolgt, ist oft der kritischste Teil einer Analyse".

Die Modellauswahl kann sich auch auf das Problem der Auswahl einiger weniger repräsentativer Modelle aus einer großen Menge von Rechenmodellen zum Zweck der Entscheidungsfindung oder Optimierung unter Unsicherheit beziehen .

Einführung

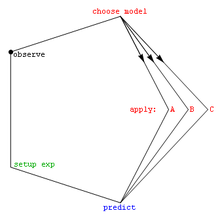

In ihren grundlegendsten Formen ist die Modellauswahl eine der grundlegenden Aufgaben der wissenschaftlichen Forschung . Die Bestimmung des Prinzips, das eine Reihe von Beobachtungen erklärt, ist oft direkt mit einem mathematischen Modell verbunden, das diese Beobachtungen vorhersagt. Als Galileo beispielsweise seine Experimente mit geneigter Ebene durchführte, zeigte er, dass die Bewegung der Kugeln zu der von seinem Modell vorhergesagten Parabel passte.

Wie kann man aus den unzähligen möglichen Mechanismen und Prozessen, die die Daten hätten produzieren können, überhaupt das beste Modell auswählen? Der üblicherweise gewählte mathematische Ansatz entscheidet zwischen einer Reihe von Kandidatenmodellen; dieser Satz muss vom Forscher ausgewählt werden. Oft werden, zumindest anfangs, einfache Modelle wie Polynome verwendet. Burnham & Anderson (2002) betonen in ihrem gesamten Buch, wie wichtig es ist, Modelle zu wählen, die auf soliden wissenschaftlichen Prinzipien basieren, wie zum Beispiel dem Verständnis der phänomenologischen Prozesse oder Mechanismen (zB chemische Reaktionen), die den Daten zugrunde liegen.

Nachdem der Satz von Kandidatenmodellen ausgewählt wurde, ermöglicht uns die statistische Analyse, das beste dieser Modelle auszuwählen. Was mit am besten gemeint ist, ist umstritten. Eine gute Modellauswahltechnik wird die Anpassungsgüte mit der Einfachheit in Einklang bringen. Komplexere Modelle können ihre Form besser an die Daten anpassen (beispielsweise kann ein Polynom fünfter Ordnung genau sechs Punkte passen), aber die zusätzlichen Parameter stellen möglicherweise nichts Nützliches dar. (Vielleicht sind diese sechs Punkte wirklich nur zufällig um eine gerade Linie verteilt.) Die Anpassungsgüte wird im Allgemeinen unter Verwendung eines Likelihood-Ratio- Ansatzes oder einer Annäherung daran bestimmt, was zu einem Chi-Quadrat-Test führt . Die Komplexität wird im Allgemeinen gemessen, indem die Anzahl der Parameter im Modell gezählt wird.

Modellauswahltechniken können als Schätzer einer physikalischen Größe betrachtet werden, wie etwa der Wahrscheinlichkeit, dass das Modell die gegebenen Daten erzeugt. Die Bias und Varianz sind wichtige Maßnahmen für die Qualität dieser Schätzer; Auch die Effizienz wird häufig berücksichtigt.

Ein Standardbeispiel für die Modellauswahl ist die Kurvenanpassung , bei der wir bei einer gegebenen Menge von Punkten und anderem Hintergrundwissen (z. B. Punkte sind das Ergebnis von iid- Samples) eine Kurve auswählen müssen, die die Funktion beschreibt, die die Punkte erzeugt hat.

Zwei Richtungen der Modellauswahl

Es gibt zwei Hauptziele bei der Inferenz und dem Lernen aus Daten. Einer dient der wissenschaftlichen Entdeckung, dem Verständnis des zugrunde liegenden Datengenerierungsmechanismus und der Interpretation der Natur der Daten. Ein weiteres Ziel des Lernens aus Daten ist die Vorhersage zukünftiger oder unsichtbarer Beobachtungen. Beim zweiten Ziel geht es dem Data Scientist nicht unbedingt um eine genaue probabilistische Beschreibung der Daten. Natürlich kann man sich auch für beide Richtungen interessieren.

Entsprechend den beiden unterschiedlichen Zielsetzungen kann die Modellauswahl auch zwei Richtungen haben: Modellauswahl für Inferenz und Modellauswahl für Vorhersage. Die erste Richtung besteht darin, das beste Modell für die Daten zu identifizieren, das vorzugsweise eine zuverlässige Charakterisierung der Unsicherheitsquellen für die wissenschaftliche Interpretation liefert. Für dieses Ziel ist es von wesentlicher Bedeutung, dass das ausgewählte Modell nicht zu empfindlich auf die Stichprobengröße reagiert. Dementsprechend ist ein geeigneter Begriff zum Bewerten der Modellauswahl die Auswahlkonsistenz, was bedeutet, dass der robusteste Kandidat bei ausreichend vielen Datenproben konsistent ausgewählt wird.

Die zweite Richtung besteht darin, ein Modell als Maschine zu wählen, das eine hervorragende Vorhersageleistung bietet. Bei letzterem kann das gewählte Modell jedoch nur der glückliche Gewinner unter wenigen engen Konkurrenten sein, die Vorhersageleistung kann jedoch immer noch die bestmögliche sein. Wenn dies der Fall ist, ist die Modellauswahl für das zweite Ziel (Vorhersage) in Ordnung, aber die Verwendung des ausgewählten Modells zur Einsicht und Interpretation kann sehr unzuverlässig und irreführend sein. Darüber hinaus können bei auf diese Weise ausgewählten sehr komplexen Modellen sogar Vorhersagen für Daten, die sich nur geringfügig von denen unterscheiden, auf denen die Auswahl getroffen wurde, unzumutbar sein.

Methoden zur Unterstützung bei der Auswahl des Satzes von Kandidatenmodellen

- Datentransformation (Statistik)

- Explorative Datenanalyse

- Modellspezifikation

- Wissenschaftliche Methode

Kriterien

Nachfolgend finden Sie eine Liste von Kriterien für die Modellauswahl. Die am häufigsten verwendeten Kriterien sind (i) das Akaike-Informationskriterium und (ii) der Bayes-Faktor und/oder das Bayessche Informationskriterium (das dem Bayes-Faktor in gewissem Maße nahe kommt), siehe Stoica & Selen (2004) für eine Übersicht.

- Akaike Informationskriterium (AIC), ein Maß für die Güte eines geschätzten statistischen Modells

- Bayes-Faktor

- Bayessches Informationskriterium (BIC), auch bekannt als Schwarz-Informationskriterium, ein statistisches Kriterium für die Modellauswahl

- Bridge-Kriterium (BC), ein statistisches Kriterium, das trotz geeigneter Modellspezifikationen die bessere Leistung von AIC und BIC erreichen kann.

- Kreuzvalidierung

- Abweichungsinformationskriterium (DIC), ein weiteres Bayes-orientiertes Modellauswahlkriterium

- Rate falscher Entdeckungen

- Fokussiertes Informationskriterium (FIC), ein Auswahlkriterium, das statistische Modelle nach ihrer Wirksamkeit für einen bestimmten Fokusparameter sortiert

- Hannan-Quinn-Informationskriterium , eine Alternative zu den Akaike- und Bayes-Kriterien

- Das Kashyap-Informationskriterium (KIC) ist eine leistungsstarke Alternative zu AIC und BIC, da KIC die Fisher-Informationsmatrix verwendet

- Likelihood-Ratio-Test

- Mallows C p

- Mindestlänge der Beschreibung

- Mindestnachrichtenlänge (MML)

- PRESSE-Statistik , auch bekannt als PRESS-Kriterium

- Strukturelle Risikominimierung

- Schrittweise Regression

- Watanabe-Akaike-Informationskriterium (WAIC), auch als weit verbreitetes Informationskriterium bezeichnet

- Extended Bayesian Information Criterion (EBIC) ist eine Erweiterung des gewöhnlichen Bayesian Information Criterion (BIC) für Modelle mit hohen Parameterräumen.

- Extended Fisher Information Criterion (EFIC) ist ein Modellauswahlkriterium für lineare Regressionsmodelle.

Unter diesen Kriterien ist die Kreuzvalidierung typischerweise das genaueste und rechnerisch am teuersten für überwachte Lernprobleme.

Burnham & Anderson (2002 , §6.3) sagen folgendes:

Es gibt verschiedene Methoden zur Modellauswahl. Im Hinblick auf die statistische Leistung einer Methode und den beabsichtigten Kontext ihrer Verwendung gibt es jedoch nur zwei verschiedene Klassen von Methoden: Diese wurden als effizient und konsistent bezeichnet . (...) Unter dem frequentistischen Paradigma zur Modellauswahl hat man im Allgemeinen drei Hauptansätze: (I) Optimierung einiger Auswahlkriterien, (II) Hypothesentests und (III) Ad-hoc-Methoden.

Siehe auch

- Alle Modelle sind falsch

- Analyse konkurrierender Hypothesen

- Automatisiertes maschinelles Lernen (AutoML)

- Bias-Varianz-Dilemma

- Merkmalsauswahl

- Freedmans Paradoxon

- Rastersuche

- Identifizierbarkeitsanalyse

- Log-lineare Analyse

- Modellidentifikation

- Ockhams Rasiermesser

- Optimales Design

- Problem bei der Parameteridentifikation

- Wissenschaftliche Modellierung

- Statistische Modellvalidierung

- Steins Paradoxon

Anmerkungen

Verweise

- Aho, K.; Derryberry, D.; Peterson, T. (2014), "Model selection for ecologists: the worldviews of AIC and BIC", Ecology , 95 (3): 631–636, doi : 10.1890/13-1452.1 , PMID 24804445

- Akaike, H. (1994), "Implications of informational view on the development of Statistical Science", in Bozdogan, H. (Hrsg.), Proceedings of the First US/JAPAN Conference on The Frontiers of Statistical Modeling: An Informational Ansatz – Band 3 , Kluwer Academic Publishers , S. 27–38

- Anderson, DR (2008), Modellbasierte Inferenz in den Biowissenschaften , Springer, ISBN 9780387740751

- Ando, T. (2010), Bayesian Model Selection and Statistical Modeling , CRC Press , ISBN 9781439836156

- Breiman, L. (2001), "Statistical modeling: the two cultures", Statistical Science , 16 : 199–231, doi : 10.1214/ss/1009213726

- Burnham, KP; Anderson, DR (2002), Model Selection and Multimodel Inference: A Practical Information-Theoretic Approach (2. Aufl.), Springer-Verlag, ISBN 0-387-95364-7[dies hat über 38000 Zitate bei Google Scholar ]

- Chamberlin, TC (1890), "Die Methode der multiplen Arbeitshypothesen", Science , 15 (366): 92–6, Bibcode : 1890Sci....15R..92. , doi : 10.1126/science.ns-15.366.92 , PMID 17782687(Nachdruck 1965, Science 148: 754–759 [1] doi : 10.1126/science.148.3671.754 )

- Claeskens, G. (2016), "Statistical model choice" (PDF) , Annual Review of Statistics and Its Application , 3 (1): 233–256, Bibcode : 2016AnRSA...3..233C , doi : 10.1146/annurev -Statistik-041715-033413

- Claeskens, G.; Hjort, NL (2008), Modellauswahl und Modellmittelung , Cambridge University Press, ISBN 9781139471800

- Cox, DR (2006), Prinzipien der statistischen Inferenz , Cambridge University Press

- Kashyap, RL (1982), „Optimal choice of AR and MA parts in autoregressive Moving Average Models“, IEEE Transactions on Pattern Analysis and Machine Intelligence , IEEE, PAMI-4 (2): 99–104, doi : 10.1109/TPAMI. 1982.4767213 , PMID 21869012 , S2CID 18484243

- Konishi, S.; Kitagawa, G. (2008), Information Criteria and Statistical Modeling , Springer, Bibcode : 2007icsm.book.....K , ISBN 9780387718866

- Lahiri, P. (2001), Modellauswahl , Institut für Mathematische Statistik

- Leeb, H.; Pötscher, BM (2009), "Modellauswahl", in Anderson, TG (Hrsg.), Handbook of Financial Time Series , Springer, S. 889–925, doi : 10.1007/978-3-540-71297-8_39 , ISBN 978-3-540-71296-1

- Lukäcs, PM; Thompson, WL; Kendall, WL; Gould, WR; Doherty, PF Jr.; Burnham, KP; Anderson, DR (2007), „Bedenken hinsichtlich eines Rufs nach Pluralismus der Informationstheorie und Hypothesenprüfung“, Journal of Applied Ecology , 44 (2): 456–460, doi : 10.1111/j.1365-2664.2006.01267.x

- McQuarrie, Allan DR; Tsai, Chih-Ling (1998), Regression and Time Series Model Selection , Singapur: World Scientific, ISBN 981-02-3242-X

- Massart, P. (2007), Konzentrationsungleichungen und Modellauswahl , Springer

- Massart, P. (2014), „Ein nicht asymptotischer Spaziergang in Wahrscheinlichkeit und Statistik“ , in Lin, Xihong (Hrsg.), Past, Present, and Future of Statistical Science , Chapman & Hall , S. 309–321, ISBN 9781482204988

- Navarro, DJ (2019), "Between the Devil and the Deep Blue Sea: Spannungen zwischen wissenschaftlicher Beurteilung und statistischer Modellauswahl", Computational Brain & Behavior , 2 : 28–34, doi : 10.1007/s42113-018-0019-z

- Resende, Paulo Angelo Alves; Dorea, Chang Chung Yu (2016), "Model Identification using the Efficient Determination Criterion", Journal of Multivariate Analysis , 150 : 229–244, arXiv : 1409.7441 , doi : 10.1016/j.jmva.2016.06.002 , S2CID 5469654

- Shmueli, G. (2010), "Erklären oder vorhersagen?" , Statistische Wissenschaft , 25 (3): 289–310, arXiv : 1101.0891 , doi : 10.1214/10-STS330 , MR 2791669 , S2CID 15900983

- Stoica, P.; Selen, Y. (2004), "Model-order selection: a review of information Criteria Rules" (PDF) , IEEE Signal Processing Magazine , 21 (4): 36–47–

- Witz, E.; van den Heuvel, E.; Romeijn, J.-W. (2012), " ' All models are false...': an Introduction to model equation" (PDF) , Statistica Neerlandica , 66 (3): 217–236, doi : 10.1111/j.1467-9574.2012.00530.x

- Witz, E.; McCullagh, P. (2001), Viana, MAG; Richards, D. St. P. (Hrsg.), „Die Erweiterbarkeit statistischer Modelle“, Algebraic Methods in Statistics and Probability , S. 327–340

- Wójtowicz, Anna; Bigaj, Tomasz (2016), "Begründung, Bestätigung und das Problem sich gegenseitig ausschließender Hypothesen", in Kuźniar, Adrian; Odrowąż-Sypniewska, Joanna (Hrsg.), Uncovering Facts and Values , Brill Publishers , S. 122–143, doi : 10.1163/9789004312654_009 , ISBN 9789004312654

- Owrang, Arash; Jansson, Magnus (2018), "A Model Selection Criterion for High-Dimensional Linear Regression" , IEEE Transactions on Signal Processing , 66 (13): 3436–3446, Bibcode : 2018ITSP...66.3436O , doi : 10.1109/TSP. 2018.2821628 , ISSN 1941-0476 , S2CID 46931136